Parte 3 — El problema del dato en inteligencia artificial

Si en la etapa anterior el foco estuvo en cómo un sistema construye una decisión a partir de un modelo, el siguiente nivel de análisis obliga a desplazar la atención hacia un elemento menos visible pero determinante: los datos.

Desde un punto de vista técnico, el comportamiento de un sistema de inteligencia artificial no está definido únicamente por su arquitectura o por el algoritmo que utiliza. Está condicionado, de manera estructural, por el conjunto de datos sobre el cual se entrena.

Un modelo no aprende del mundo en sentido directo. Aprende de una representación del mundo, necesariamente parcial, filtrada y construida.

Aprendizaje como ajuste sobre una representación

El aprendizaje automático consiste en ajustar un sistema para que sus salidas se aproximen a determinados resultados esperados. Ese ajuste se realiza de forma iterativa, reduciendo la diferencia entre lo que el modelo produce y lo que debería producir.

Sin embargo, ese proceso no ocurre en abstracto. Ocurre sobre un conjunto específico de datos.

Esto introduce una condición fundamental: el sistema no accede a la realidad, sino a un subconjunto de observaciones que la representan. Todo lo que el modelo puede inferir, generalizar o predecir está limitado por esa base.

En consecuencia, la inteligencia del sistema no puede separarse de la calidad, estructura y alcance de los datos disponibles.

Dependencia estructural del dataset

El comportamiento final de un modelo está determinado por qué datos se incluyen y cuáles quedan fuera. Esta selección no es neutra.

Si ciertos patrones, situaciones o excepciones no están representados en el conjunto de entrenamiento, el sistema no tiene base estadística para incorporarlos en su comportamiento. No se trata de una limitación circunstancial, sino de una propiedad estructural.

El modelo no puede aprender aquello que no está presente.

Esta restricción se vuelve crítica en entornos complejos, donde la variabilidad del mundo supera ampliamente cualquier dataset finito.

Jerarquía de los datos

Aun dentro de un mismo conjunto de entrenamiento, no todos los datos contribuyen de la misma manera al comportamiento del modelo.

Aunque el aprendizaje se realiza sobre grandes volúmenes de información, el impacto de cada observación no es uniforme. Algunas instancias tienen un efecto desproporcionado sobre el ajuste del sistema, mientras que otras aportan información marginal o redundante.

Esta asimetría introduce una jerarquía implícita.

Desde el punto de vista del aprendizaje, ciertos datos:

- definen fronteras de decisión,

- corrigen errores significativos,

- aportan información crítica sobre casos límite,

mientras que otros simplemente refuerzan patrones ya aprendidos.

El modelo no trata todos los ejemplos como equivalentes, incluso si formalmente están dentro del mismo dataset.

Peso, relevancia y optimización

Esta jerarquía no está definida explícitamente, pero emerge del propio proceso de optimización.

Durante el entrenamiento, no todos los errores tienen el mismo impacto. Dependiendo de la función de pérdida y de la estructura del modelo, ciertos errores generan ajustes más significativos en los parámetros. En consecuencia, los datos asociados a esos errores adquieren mayor influencia.

Esto introduce una forma de priorización operativa:

algunos ejemplos “pesan” más que otros en la construcción del modelo.

Este comportamiento es comparable, en términos estructurales, a sistemas donde ciertos eventos tienen prioridad sobre otros. En arquitecturas de bajo nivel, por ejemplo, un sistema de interrupciones define qué eventos deben ser atendidos antes. En aprendizaje automático, esa prioridad no está codificada de manera explícita, pero emerge del proceso de ajuste.

El sistema no distribuye su atención de manera uniforme. La concentra donde el error es más relevante.

Atención y selección de información

En modelos modernos, esta idea de jerarquía se vuelve aún más explícita.

Algunas arquitecturas incorporan mecanismos que permiten al sistema asignar diferentes niveles de importancia a distintas partes de la información de entrada. Esto implica que el modelo no solo aprende patrones, sino que aprende también a qué partes de esos patrones prestar más atención.

Este tipo de mecanismos no cambia la naturaleza del sistema, pero hace visible algo que ya estaba presente:

no toda la información contribuye de la misma manera a la decisión

La inteligencia del modelo no depende únicamente de la cantidad de datos, sino de cómo distribuye su capacidad de representación sobre ellos.

Distribución de entrenamiento y entorno real

Otro aspecto crítico es la diferencia entre el contexto en el que el sistema se entrena y aquel en el que finalmente opera.

El entrenamiento ocurre bajo una distribución de datos específica. El uso del sistema, en cambio, puede implicar escenarios distintos, con características no contempladas durante el entrenamiento.

Cuando ambas distribuciones coinciden, el sistema funciona de manera consistente. Cuando divergen, aparece el problema central del cambio de distribución.

En ese punto, el rendimiento puede degradarse de forma significativa, incluso si el sistema había mostrado resultados sólidos en condiciones controladas.

El problema no está necesariamente en el modelo. Está en la diferencia entre la representación disponible y el entorno real.

Sesgo como propiedad interna

Los datos no son una muestra neutra del mundo. Están atravesados por decisiones de recolección, limitaciones técnicas, contextos históricos y condiciones específicas.

Un modelo entrenado sobre estos datos incorpora esas estructuras.

No distingue entre regularidades estadísticas y relaciones causales. No interpreta. Ajusta.

Por eso, el sesgo no puede entenderse como un elemento externo que se introduce en el sistema. Es una consecuencia directa del proceso de entrenamiento.

El sistema reproduce, y en muchos casos amplifica, las características del dataset.

Escala y densidad informacional

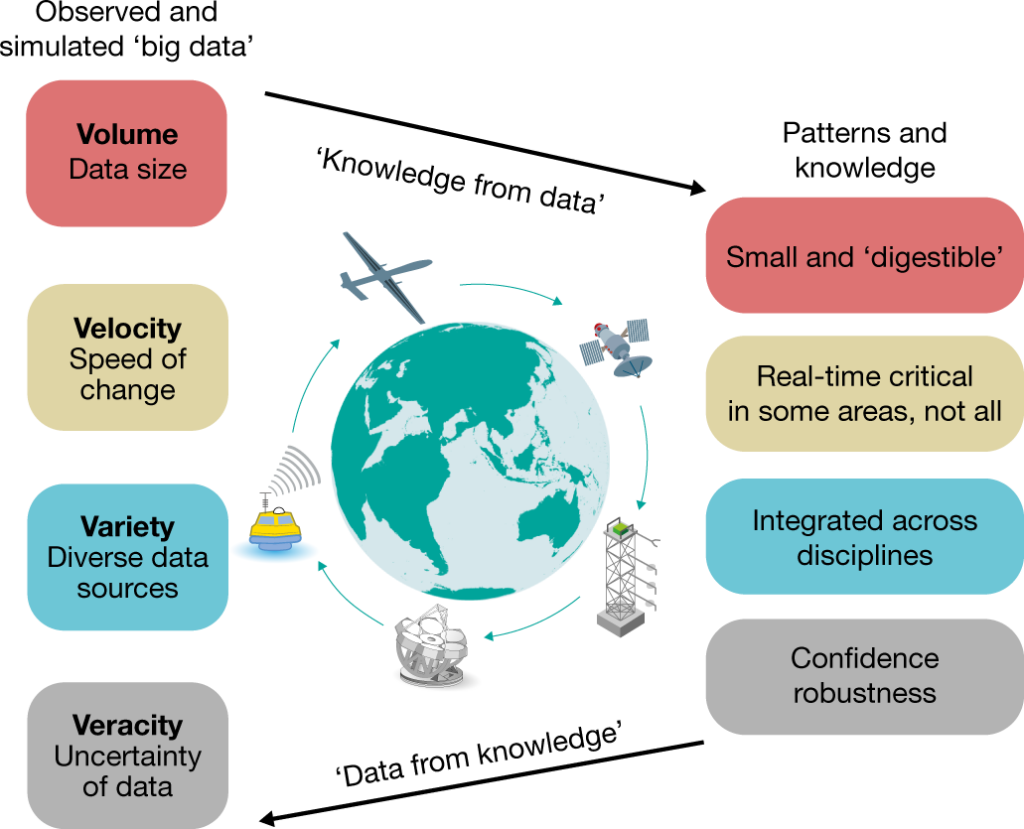

El aumento en la cantidad de datos ha sido uno de los motores principales del desarrollo reciente de la inteligencia artificial. Modelos más grandes, entrenados sobre volúmenes masivos de información, han mostrado mejoras significativas.

Sin embargo, este crecimiento tiene límites.

No todo incremento en volumen implica un incremento equivalente en información útil. A medida que los datasets crecen, también lo hacen la redundancia y el ruido.

En grandes volúmenes de datos:

- muchos elementos repiten información,

- pocos contienen señales críticas,

- algunos definen comportamientos completos del modelo.

Esto introduce una idea clave: lo relevante no es solo cuánto dato hay, sino cuánta información efectiva contiene.

El error como función del dato

Dado que el aprendizaje automático consiste en reducir error, y que ese error se mide sobre los datos disponibles, se deduce que el rendimiento del sistema está condicionado por la calidad de esa base.

Si los datos contienen inconsistencias, ruido o errores de etiquetado, el modelo no puede superarlos completamente. Puede suavizar sus efectos, pero no eliminarlos.

El límite del sistema está definido por el límite del dato.

Generalización y alcance

La capacidad de generalizar permite a los modelos responder a situaciones no vistas durante el entrenamiento. Sin embargo, esta capacidad está acotada por el espacio estadístico definido por los datos.

Cuando el sistema enfrenta situaciones fuera de ese espacio, su desempeño puede deteriorarse de forma abrupta.

Los modelos no construyen conocimiento en sentido fuerte. Construyen aproximaciones consistentes dentro de un dominio.

Conclusión

La inteligencia artificial contemporánea no puede entenderse sin su dependencia estructural de los datos.

Los sistemas no operan directamente sobre el mundo, sino sobre representaciones del mismo, necesariamente incompletas y jerárquicamente desiguales.

No todos los datos pesan lo mismo.

No todos los errores importan por igual.

No toda la información contribuye de la misma manera.

] }El límite de la inteligencia artificial no es el modelo.

Es el dato, y la forma en que ese dato estructura el aprendizaje.

Seguí las últimas noticias de robótica en español.