Parte 1 — De los autómatas a los sistemas de decisión

Antes de abordar la inteligencia artificial en términos técnicos, conviene situar el problema en una perspectiva histórica más amplia. La idea de construir artefactos capaces de ejecutar conductas complejas, responder al entorno o incluso imitar ciertas funciones de la mente no nace con la computación moderna. Forma parte de una tradición mucho más larga: la de los autómatas, las máquinas de cálculo y, finalmente, los sistemas formales de decisión.

Autómatas: la simulación mecánica de la conducta

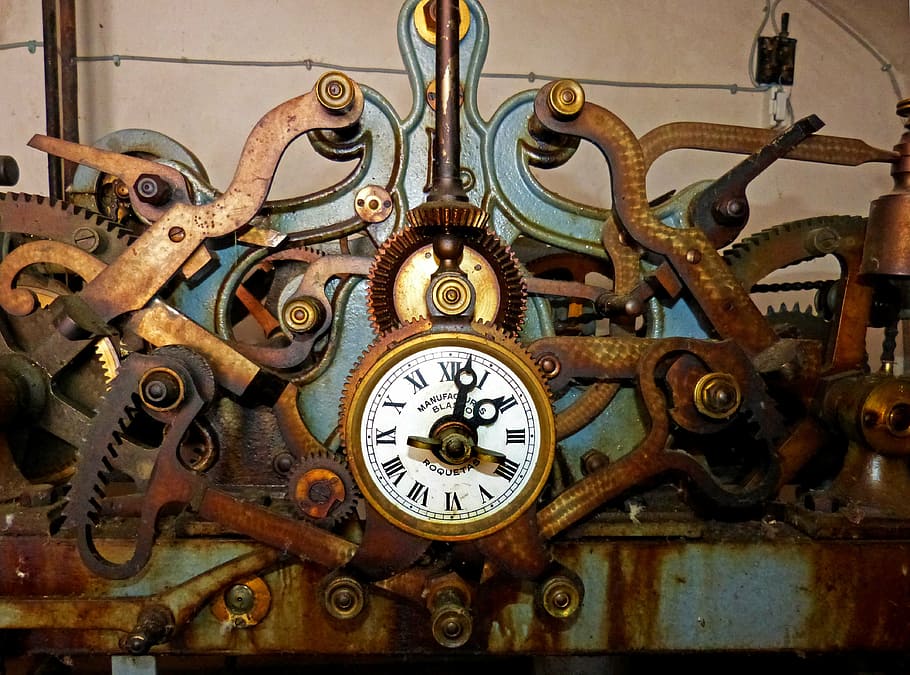

Mucho antes de la informática, distintas civilizaciones desarrollaron mecanismos capaces de producir movimientos automáticos. En el mundo helenístico, en la tradición árabe medieval y, más tarde, en la Europa renacentista y barroca, se construyeron dispositivos que movían figuras, accionaban relojes astronómicos o reproducían secuencias predeterminadas de acción.

Estos artefactos no “pensaban” ni decidían. Su comportamiento estaba completamente contenido en su diseño físico: engranajes, resortes, contrapesos, levas, válvulas hidráulicas o sistemas neumáticos. Mecanismos de relojeria con múltiples ejes de movimientos genealmente eran el motor principal de esos autómatas.

Sin embargo, introducían una idea decisiva: una conducta aparentemente compleja podía producirse mediante una estructura material organizada.

Ese fue el primer gran antecedente conceptual. Allí apareció la posibilidad de descomponer una acción en componentes mecánicos.

De la acción automática al cálculo formal

El siguiente salto no fue mecánico, sino abstracto.

Con el desarrollo de la lógica matemática y de las primeras máquinas de cálculo, el problema dejó de ser únicamente cómo automatizar un movimiento y pasó a ser cómo automatizar una operación intelectual.

La diferencia es fundamental. Un autómata reproduce una secuencia de acciones. Una máquina de cálculo ejecuta operaciones sobre símbolos. En ese momento comienza a emerger la idea de que ciertos aspectos del razonamiento podrían formalizarse.

Durante los siglos XVII al XIX, distintos desarrollos en lógica, álgebra y teoría del cálculo fueron preparando ese terreno. Pero es en el siglo XX cuando el problema adquiere una forma rigurosa: si un proceso puede expresarse como una secuencia finita de reglas, entonces puede ser ejecutado por una máquina.

Con esa formulación nace la computación moderna.

La hipótesis fuerte: la mente como sistema formal

Una parte importante de las primeras investigaciones en inteligencia artificial se apoyó en una hipótesis muy concreta: que el razonamiento humano podía representarse como manipulación formal de símbolos.

Dicho de otro modo, si pensar consistía en aplicar reglas a representaciones, entonces una máquina suficientemente bien diseñada podría reproducir ese proceso.

Esta hipótesis orientó buena parte del trabajo de mediados del siglo XX. Los primeros programas capaces de resolver problemas lógicos, jugar ajedrez o demostrar teoremas no aprendían de la experiencia ni ajustaban su comportamiento estadísticamente. Funcionaban porque alguien había definido de antemano:

- el lenguaje del problema,

- las reglas de transformación,

- los criterios de solución.

La inteligencia artificial, en su primera etapa, fue esencialmente simbólica.

El nacimiento del enfoque simbólico

En las décadas de 1950 y 1960 se consolidó la idea de que la inteligencia artificial podía desarrollarse construyendo sistemas que operaran con símbolos, reglas e inferencias. El objetivo no era replicar el cerebro en su dimensión biológica, sino reproducir ciertas capacidades cognitivas mediante estructuras formales.

El sistema recibía hechos o premisas, aplicaba reglas lógicas y producía conclusiones. La máquina no “comprendía” en un sentido humano; ejecutaba transformaciones válidas dentro de un sistema formal.

Este enfoque tuvo logros importantes. Permitió demostrar que actividades tradicionalmente asociadas a la inteligencia, como resolver problemas o seguir cadenas de inferencia, podían implementarse computacionalmente. Pero también mostró, con el tiempo, que la inteligencia no podía reducirse sin más a un conjunto explícito de reglas.

Los caminos empezaron a abrirse, y luego a cruzarse, para luego entrecruzarse nuevamente.

Las cosas eran bastante mas complejas de lo que aparentaban ser.

Sistemas expertos: el punto más alto del paradigma basado en reglas

La culminación práctica de esta etapa llegó con los sistemas expertos de las décadas de 1970 y 1980. Estos sistemas buscaban capturar el conocimiento de especialistas humanos y convertirlo en una base de reglas utilizable por una máquina.

Su arquitectura típica incluía:

- una base de conocimiento,

- un motor de inferencia,

- un conjunto de reglas del tipo “si-entonces”.

En ámbitos acotados podían ofrecer resultados muy eficaces. Diagnóstico médico, análisis geológico, evaluación técnica o soporte a decisiones empresariales fueron algunos de los campos donde estos sistemas mostraron utilidad real.

El supuesto central seguía siendo el mismo: si el conocimiento de un experto podía expresarse formalmente, entonces podía automatizarse.

El límite de las reglas

El problema apareció cuando los dominios dejaron de ser cerrados, estables y relativamente pequeños. A medida que la complejidad del entorno aumentaba, el enfoque basado en reglas comenzó a mostrar límites profundos.

Entre ellos:

- dificultad para escalar el número de reglas,

- problemas para representar conocimiento implícito o contextual,

- fragilidad frente a excepciones, ruido o información incompleta,

- dependencia permanente de intervención humana para actualizar el sistema.

La inteligencia, entendida como ejecución correcta de reglas, resultó insuficiente para entornos abiertos.

Ese límite fue decisivo. No porque invalidara por completo el trabajo anterior, sino porque obligó a cambiar de pregunta.

Cambio de eje: del conocimiento explícito al ajuste

La transición hacia la inteligencia artificial contemporánea se produce cuando el centro del problema deja de ser la codificación manual del conocimiento y pasa a ser el ajuste del sistema a partir de datos.

En lugar de decirle a la máquina qué regla aplicar en cada caso, se comienza a entrenar modelos para que detecten regularidades por sí mismos.

Este cambio reubica la historia previa. Los autómatas habían mostrado que una conducta podía descomponerse mecánicamente. La lógica formal había mostrado que ciertos procesos podían expresarse simbólicamente. Los sistemas expertos habían intentado convertir conocimiento en reglas.

La etapa actual conserva algo de todo eso, pero introduce una diferencia central: el sistema ya no depende exclusivamente de una estructura fija diseñada de antemano. Depende de su capacidad de ajuste.

Conclusión

La inteligencia artificial no surgió de manera repentina, ni puede entenderse solo a partir de los avances recientes en modelos de aprendizaje. Es el resultado de una trayectoria histórica que va desde la automatización mecánica de la conducta hasta la formalización computacional de la decisión.

Ese recorrido permite ver con claridad que el problema nunca fue estrictamente construir máquinas que “piensen”, sino construir sistemas capaces de producir respuestas consistentes frente a situaciones variables.

En sus primeras etapas, la respuesta fue mecánica o lógica.

Más tarde, fue simbólica.

Hoy, es estadística y adaptativa.

Ese desplazamiento abre el núcleo de la serie: entender cómo se pasó de sistemas basados en reglas a sistemas que aprenden reduciendo error.

Seguí las últimas noticias de robótica en español.